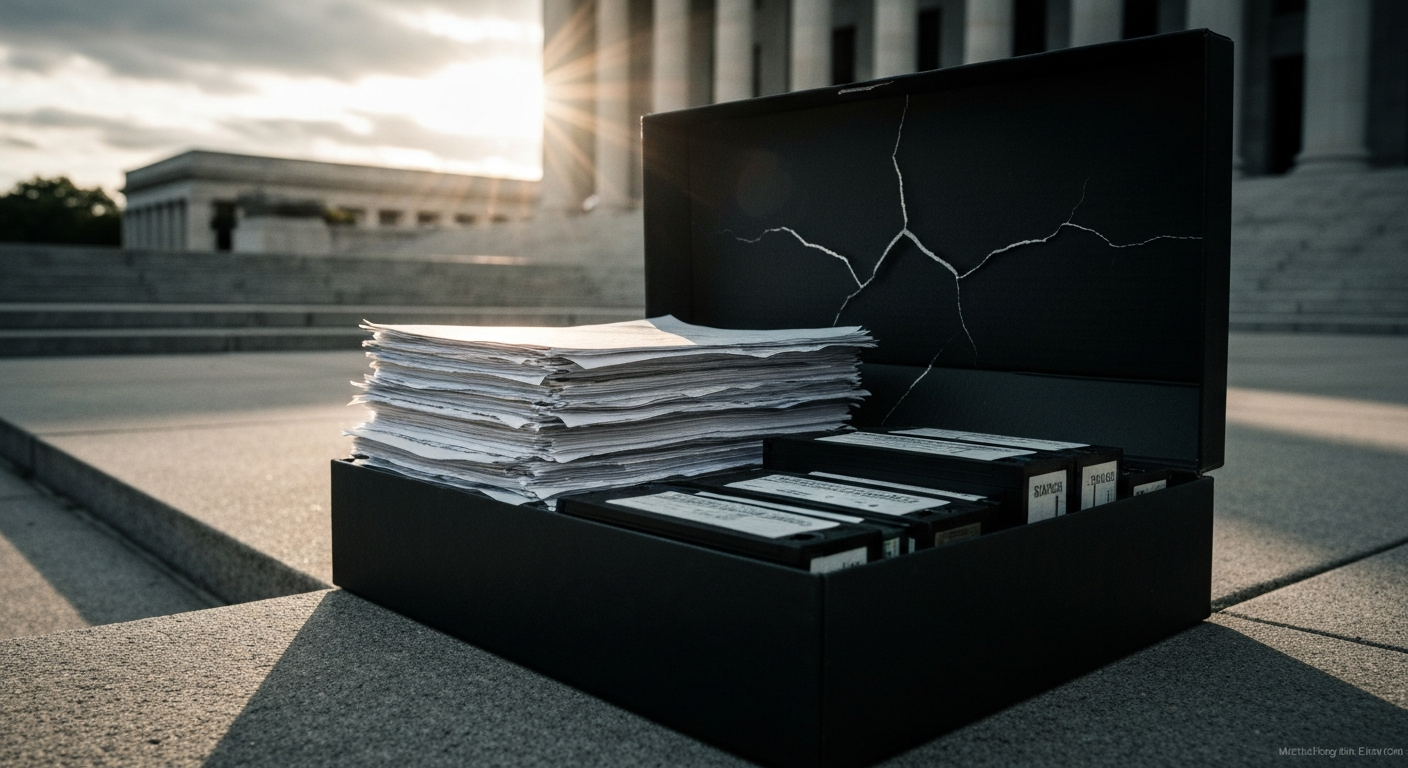

伊隆·馬斯克(Elon Musk)創立的人工智慧公司 xAI,試圖阻止加州「*AI 透明度法*」上路的行動宣告失敗。要求公開生成式 AI 模型訓練「*資料集*」來源與構成的 *AB 2013 法案* 如期生效,意味過去被視為「*黑箱*」的訓練資料慣行,正面臨更直接的監管壓力。

根據美國 현지 보도,於 26 日(當地時間)作出的法院決定,讓 AB 2013 在加州持續生效。由於加州匯聚眾多主流 AI 企業,且州法經常被其他州「*複製貼上*」成為事實上的全國標準,此案被業界解讀為:繞過「*訓練數據透明度*」的空間,將愈來愈小。

AB 2013 於 2026 年 1 月 1 日正式生效,適用對象為在加州經營業務、並訓練 *生成式 AI 模型* 的企業。法案核心要求,是要對用於訓練的「*資料來源*」與「*資料構成*」進行「*具實質意義程度*」的公開;涵蓋文字、影像、程式碼等關鍵訓練資料。這代表不只 xAI,包括 *OpenAI、Google、Anthropic* 等美國主力 AI 開發商,都在法案直接影響範圍內。

xAI 之所以格外敏感,是因為規定直指旗下聊天機器人「*Grok*」的競爭核心。若依 AB 2013 落實公開,外界即可追問:究竟哪些資料被納入訓練流程?資料蒐集與清理階段,是否涉及「*著作權*」侵害或欠缺授權?同時,一旦「*訓練資料結構*」被攤開,等同向競爭對手曝露高度機密的「*產品策略*」,這也是 xAI 對外強調的主要疑慮。

xAI 在法案生效前夕的 2025 年 12 月 29 日,向聯邦法院提起訴訟,要求凍結 AB 2013 的效力。公司主張大致分為兩點:其一,強制公開訓練數據,構成對企業的「*強迫發言(compelled speech)*」,侵犯美國憲法第一修正案保障的「*言論自由*」;其二,公開義務實質上是逼迫企業將「*營業祕密*」交給競爭對手與大眾,侵蝕企業資產與商業基礎。

xAI 同步申請在正式判決前暫停執行的「*假處分(預備禁止命令)*」。相關聽證於 2026 年 2 月 26 日舉行,法院並向加州司法部就未來執法計畫提出質詢。外界分析指出,加州方面當時未在程序上明確交代具體執法時間表,反而「*間接削弱*」了 xAI 的主張。由於法院頒布緊急救濟的前提,是必須看到「*立即且具體的損害*」,當執行節奏模糊不清時,潛在損害更像是「*假設性風險*」,使法官較難認定假處分要件已符合。最終結果是 AB 2013 在加州持續生效,xAI 阻止法案落地的首輪攻勢宣告落空。

更令市場關注的是時間點的巧合。就在本案結果曝光前一日,即 2 月 25 日,xAI 對 *OpenAI* 提起的另一宗「*營業祕密侵占*」聯邦訴訟,也被法院駁回。該案指控 OpenAI 竊取 xAI 的關鍵技術,但法庭並未接受這項說法。考量伊隆·馬斯克與 OpenAI 執行長薩姆·奧特曼(Sam Altman)之間的決裂故事早已成為產業話題,外界原本預期這場訴訟將有更戲劇性的發展,結果卻以對 xAI 不利的方式草草收場。

連續兩場官司失利,被部分法律與科技界觀察人士解讀為:聯邦法院對 xAI 的論點,並沒有市場期待中那般「*友善*」。也有人指出其中的「*反諷*」:一方面,xAI 在對加州提告時強調,訓練資料應被視為連政府都不得任意檢視的「*高度機密營業祕密*」;另一方面,在控告 OpenAI 時,xAI 又聲稱自家「*機密技術*」遭竊取,希望法院強力介入保護。如今兩案都未獲支持,顯示司法機關暫時不願沿著 xAI 的敘事線前進。

對整體 AI 產業與投資人而言,AB 2013 的落地與 xAI 的失敗,釋放出明確訊號:*「訓練數據透明度」本身,正在轉變為一項核心風險*。經濟規模約 4 兆美元的加州,過去在汽車「*排放標準*」等領域已有州法成為全國標準的前例,如今在 *AI 監管* 上,出現類似路徑的可能性相當高。隨紐約州、伊利諾州、科羅拉多州等地陸續研擬 AI 治理法案,加州「守住 AB 2013」這一前例,恐將成為其他州立法的「*正當性依據*」。

在估值與投資評價層面,「*訓練資料*」過去被視為 AI 企業最具防禦力的資產之一。外界難以得知資料內容與規模,強化了大型企業的「*不透明護城河*」。但隨著法規要求迫使企業揭露資料範圍與來源,這道護城河有被「*稀釋*」的風險。相較之下,早期即採取較高「*資料透明度*」策略的中小業者,可能反而在新環境中獲得「*制度紅利*」。

更敏感的是法律責任。當資料集被公開,創作者、媒體機構與各類「*著作權人*」,更容易檢驗自身內容是否在未獲授權情況下被用於模型訓練。在既有的生成式 AI 著作權訴訟之外,未來新增案件的門檻將被持續拉低。換句話說,*一旦「學了什麼」變得清晰,企業可能同時面臨監管單位、訴訟律師與競爭者的「多重瞄準」*。

以 xAI 為例,該公司於 2024 年底完成約 60 億美元融資,市場估值約 500 億美元。若以 1 美元兌 1,485.40 韓元的匯率換算,融資規模約 8 兆 9,124 億韓元,估值約 74 兆 2,700 億韓元。*評論*:在這樣的高估值前提下,若「Grok 訓練資料組成」在新法架構下逐步浮上檯面,尚未完全反映在估值模型中的「*監管風險、訴訟風險與聲譽風險*」,都有可能被加速「*價格化*」,成為壓抑估值的重要變數。

不過,當前最大不確定因素仍是「*執法強度*」。雖然 AB 2013 已正式生效,但加州司法部將如何鎖定「*不遵從企業*」、會不會採取「*示範性處罰*」、以及要求的資料揭露深度到什麼程度,仍未完全明朗。如果執法節奏相對溫和,業界可能仍有一段「*調整緩衝期*」;反之,若州政府選擇在數月內積極啟動調查與執行,企業恐將面臨較短時間內的「*實質公開壓力*」。

在更多州考慮 AI 治理立法、且由全球首富之一支持的 xAI 司法挑戰接連告敗的背景下,本案被普遍視為 AI 監管新階段的象徵。這不僅是 xAI 一家公司的挫敗,更標誌著生成式 AI 所倚賴的「*輕監管時代*」正在告終——未來的競爭,將不只在於參數規模與算力,更在於企業能否在「*資料來源*」與「*責任歸屬*」上,經得起愈趨嚴格的外部檢驗。

留言 0